デジタル事業におけるプライバシー保護とAI倫理の取り組み

ハイライト

パーソナルデータの活用を伴う製品・サービスは,生活者の利便性の向上,安心・安全な社会の実現,ニューノーマル下における感染拡大の防止などのメリットをもたらす。その反面,データの取得や分析の内容によっては,個人のプライバシーの侵害や倫理的な問題を引き起こす可能性がある。これらの問題に対処するためには,製品・サービスの開発段階から専門組織が参加し,発生すると考えられるリスクを洗い出して,対策を講ずることが重要である。

本稿では,デジタル事業におけるリスクマネジメントの取り組みとして,日立のプライバシー保護,AI倫理に関する活動について述べる。

1. はじめに

日本は,IoT(Internet of Things),ビッグデータ,AI(Artificial Intelligence),5G(Fifth Generation)通信など,サイバー空間とフィジカル空間を融合させるCPS(Cyber Physical System)によって経済発展と社会的課題の解決を両立する人間中心の社会を,「Society 5.0」と名付け,その実現に取り組んでいる。

日立においてもSociety 5.0を実現するため,Lumadaのコンセプトに従ってデータを利活用した新たな価値創出をめざしており,その活用範囲は拡大を続けている。しかし,データ利活用を伴うデジタル事業が飛躍的に拡大する一方で,パーソナルデータの利活用やAIによるデータ分析により引き起こされるリスクが顕在化している。

例えば,パーソナルデータを利活用する場合は,プライバシー侵害のリスクがある。また,データの分析にAIを利活用する場合には,処理が自動化されて人手による作業が介在しなくなることや,処理の過程がブラックボックス化するといったAIの特徴に起因する倫理的なリスクが出現してきている。デジタル事業の推進においては,これらのリスクへの対応がますます重要になっている。

2. デジタル事業におけるデータ利活用のリスクマネジメントのあり方

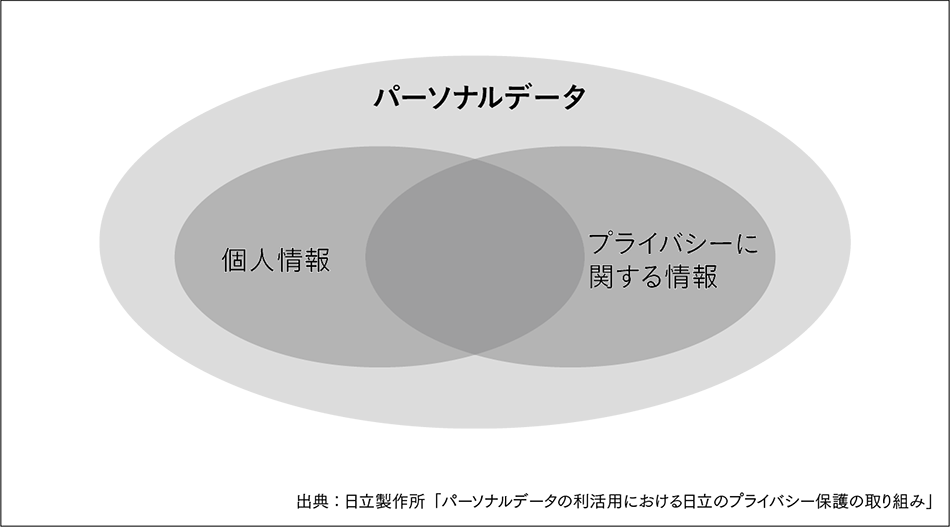

デジタル化に起因して,これまでは想定されていなかった新たなリスクが出現するようになってきた。例えば,取り扱えるデータの種類や量が増加したことなどにより,パーソナルデータを利活用する事業が拡大している。パーソナルデータとは「個人に関する情報」であり,個人情報やプライバシーに関する情報を含む。個人情報については,個人情報保護法によりその取り扱いが規定されるが,プライバシーに関する情報については,国内では法令上の明確な規定が存在しない。さらには,個人情報との境界が曖昧なグレーゾーンのデータも出てきている。このため,パーソナルデータを利活用する事業には,データ主体となる個人のプライバシーへの配慮不足というプライバシーリスクが存在すると言える。また,AI自体が判別・判断する機能を持つようになり,AIが社会実装されるようになってきたが,AIがバイアスのある判断結果を提示して個人への差別を引き起こすといった倫理的なリスクも出てきている。デジタル事業を推進するにあたっては,リーガルリスク,情報セキュリティリスク,プライバシーリスクや倫理的なリスクなどの多様かつ複合的なリスクへの対処が必要である。

日立は,従前よりそれぞれのリスクへの対応を社内のルールとして落とし込み,それぞれの管轄部門が対応しているが,デジタル事業の推進においてはプライバシーやAI倫理といったこれまで想定されていなかった新たなリスクにも対処していく必要がある。さらには,デジタル事業の多様かつ複合的なリスクに単独の部門が対処することは困難であると考える。

プライバシーやAI倫理の関わるデジタル事業のデータ利活用においては,リスクに十分に配慮し円滑に事業を推進するためのリスクマネジメントの取り組みとして,さまざまな部門と連携した専門の組織体が,CoE(Center of Excellence)として知見・ノウハウを蓄え,柔軟なリスク対応の支援を実施している。CoEが基礎的な規則やルールを策定したうえで,リスクが高いと判断される事業に対しては,CoEが事業部門に伴走して柔軟な支援を実施している。そして,外部環境などを踏まえ,適宜取り組みの見直しを実施している。

3章および4章では,日立のデジタル事業に関するリスクマネジメントの取り組みの具体事例について述べる。

3. プライバシー保護の取り組み

プライバシー保護の取り組みは,パーソナルデータを扱う事業に起因する個人のプライバシー侵害などの発生防止を目的として2014年度より実施しており,専門組織による事業支援,ガバナンスの継続的な改善という二つの特徴を持つ。

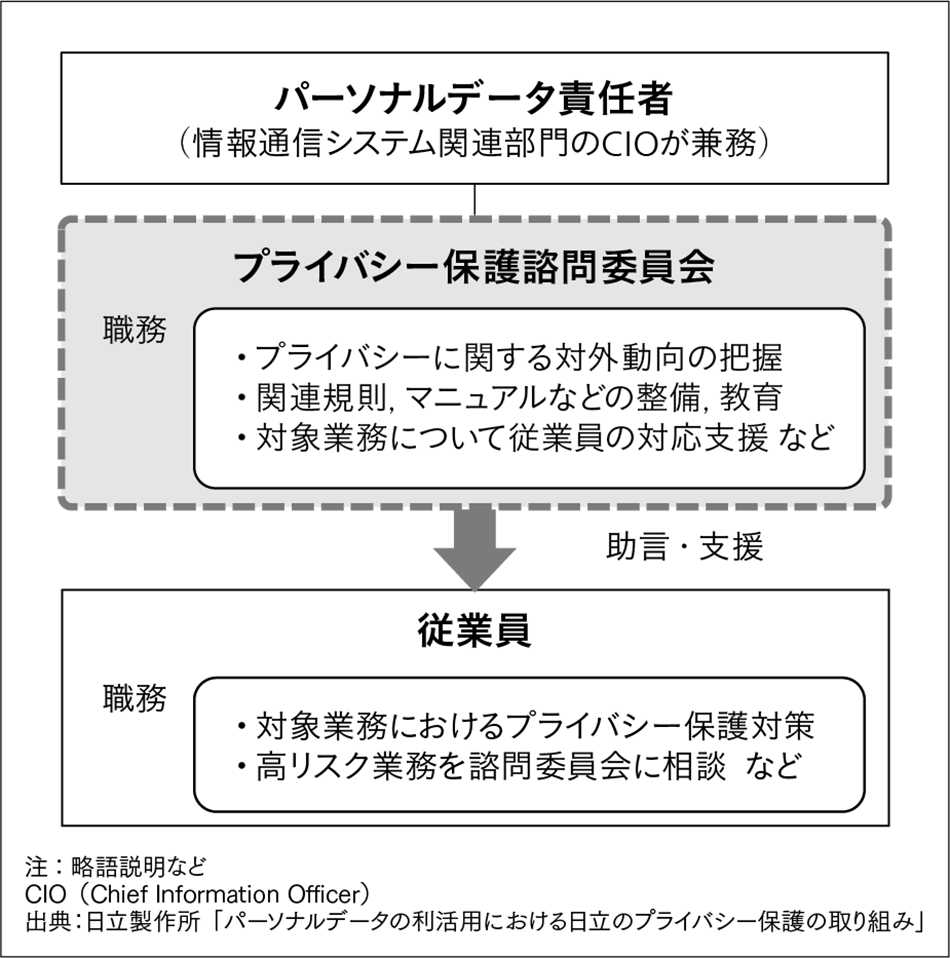

専門組織による事業支援は,プライバシー保護諮問委員会(以下,「諮問委員会」と記す。)が担っている。制度上,プライバシー保護対策は,製品・サービスの開発を担う事業部が主体で実施することとなっており,個人に関連するデータの総称であるパーソナルデータを扱うすべての事業が検討対象となる。特定の個人が容易に識別できる個人情報でなくても個人がプライバシーの侵害と感じる情報は多数存在し,これに適切に配慮するためにパーソナルデータまで対象を広げて検討することとしている。それぞれのデータの関係を図1に示す。

諮問委員会は,事業部門がプライバシー保護対策をする際の支援などを目的とした組織であり,個人情報管理,法務,調達,コンサルティングなどの領域で高度な知見を持つ委員で構成されている。また,事務局メンバーは,事業部との直接の窓口として,支援などの実務を担っている。

支援内容の一つとして,プライバシー保護対策を検討するためのリスクアセスメントの実施が挙げられる。諮問委員会は,CoEとして,プライバシー保護に関する日立グループ内外の事例や国内外の法制度の研究などにより,ナレッジを蓄積しており,それを踏まえてリスクアセスメントを行っている。また,ナレッジの蓄積の一環として,生活者を対象とした意識調査なども実施している。最新の調査は2020年10月に実施し1),新型コロナウイルス感染拡大防止を目的としたパーソナルデータの利活用に対する意識などについての知見を得た。

リスクアセスメントは,通常,事業部門からの依頼に応じて行われる。開発を計画している製品・サービスで取得するパーソナルデータ,分析内容などについて聴取したうえで,発生すると考えられるリスクを洗い出し,講ずるべきプライバシー対策などを助言する。リスクアセスメントの内容は,おおむね月1回の頻度で開催される諮問委員会の会議にて報告し,委員による議論に基づき,必要に応じて議論の結果を事業部にフィードバックする(図2参照)。

ガバナンスの継続的な改善は,幹部と諮問委員会が担っている。本取り組みは,CIO(Chief Information Officer),CSO(Chief Strategy Officer)などの幹部の積極的な関与を伴って実施している。幹部は数多くの事業部門への制度の浸透,プライバシー対策の中長期的なビジョンなどについて諮問委員会との定期的な議論を行い,諮問委員会はその内容を実践するための計画を策定し,活動している。具体的には,前述の事業部門へのリスクアセスメントに加え,制度の理解やプライバシー保護の意識の向上を目的とした教育講座の企画,実施が挙げられる。本講座は,受講機会を多く確保するため,年間4回開催され,事務局のメンバーがテキストの作成や講師を務める。リスクアセスメントや教育講座以外にも,制度の定期的な見直し,参考ドキュメントの整備など,ガバナンスを維持するためのさまざまな活動を行っているが,これらの内容は,CoEとして蓄積したナレッジなどを踏まえて検討している。諮問委員会では,KPI(Key Performance Indicator)を定めて活動自体を自己評価し,評価結果を幹部に定期的に報告するとともに,次年度以降の活動内容を検討する。

本取り組みは2021年で8年目を迎えるが,日立においては,パーソナルデータを取り扱うLumada事業が増加していること,個人のプライバシーに対する関心が社会的に高まっていることを背景とし,その重要性は増している。事業部に対してリスクアセスメントなどの支援を行った件数は,毎年増加している。また,総務省,経済産業省が2020年8月に公表した「DX時代における企業のプライバシーガバナンスガイドブック」においてもこの取り組みが紹介され,プライバシー保護の社会実装推進に貢献している。

4. AI倫理の取り組み

2021年2月,日立は「社会イノベーション事業にAIを活用するためのAI倫理原則」(以下,「AI倫理原則」と記す。)を公表した。この中で日立は,AI倫理原則として,AIの計画・社会実装・維持管理の3フェーズにおける行動基準と,これらすべてのフェーズに共通する七つの実践項目を定め,この原則に基づいてAIを利活用していくことを宣言している。これを実践するため,日立は,2021年より,AI倫理原則順守のための取り組みをスタートさせている。本取り組みも,プライバシー保護の取り組みと同様に,専門組織による事業支援,ガバナンスの継続的な改善という二つの特徴を持つ。

専門組織による事業支援としては,2021年より,日立におけるAI・アナリティクスの中核組織であるLDSL(Lumada Data Science Lab.)の中に,日立におけるAI倫理のCoEとして,データサイエンティストやプライバシー保護の専門家などから成るAI倫理専門チームを組成し,LDSLを主な対象として,AIを利活用する業務のリスクアセスメントを実施している。

AI倫理専門チームは,安全重視,公平性実現,透明性・説明責任重視などのAI倫理原則で定めている実践項目に対応したチェックリストを作成し,AIを利活用する業務のリスクを効率的に抽出できるよう工夫している。また,チェックリストの内容を踏まえ,必要に応じて対応策などを検討し,助言することで,AI倫理原則の順守に努めている。AI倫理専門チームには,AI倫理原則の策定,そのための国内外の動向や問題事例の研究などを通じて,AI倫理に関するナレッジが蓄積されており,AI倫理のリスク評価,必要なリスク対策の支援などを通じて,これを継続的に高めていく仕組みになっている。

また,AI倫理専門チームは,AI倫理のガバナンスを構築し,継続的に改善する役割も担っている。ガバナンス構築のための具体的な取り組みとしては,前述のリスクアセスメントが適切に実施されるよう,ドキュメント類の整備を行うとともに,LDSLにおける既存の事業検討プロセスへのインプロセス化を図っている。同時に,このようなプロセスの周知,AI倫理への理解の促進を目的として,研修などによる社内の普及啓発活動を実施している。そして,これらのAI倫理に関する取り組みを客観的に評価し,改善していくために,外部有識者から成るAI倫理アドバイザリーボードを設置し,助言を受けている。AI倫理アドバイザリーボードからの助言によりCoEとしてのナレッジを拡充するとともに,それを社内の規則や制度の改善,普及啓発活動,リスクアセスメントなどに反映させることで,ガバナンスを継続的に高めている。

本取り組みを通じて,日立は,社会イノベーション事業にAIを適切に活用し,社会価値・環境価値・経済価値を一層向上させるとともに,人間の尊厳に立脚した快適で持続可能な社会の実現と,世界の人々のQoL(Quality of Life)の向上に貢献することをめざす。

5. おわりに

本稿では,デジタル事業を進めるうえでのリスクマネジメントの取り組みとして,プライバシー保護とAI倫理の取り組み内容を紹介した。

専門組織が中心となって取り組みを推進し,CoEとしてナレッジを集約することで柔軟かつ迅速にリスクに対処することができる点,専門組織が日立全体のガバナンスを継続的に改善する役割を担っているという点で両者は共通している。このように,事業内容やリスクが多様化し,変化が速い時代においては,事業に対して規則などを当てはめて適合させるルールベースのアプローチではなく,専門組織が個々の事業の性質に鑑み,発生しうるリスクを特定して対策を検討するというリスクベースのアプローチが有効である。同時に,これらの取り組みを専門組織内に閉じたものにするのではなく,日立全体のガバナンスを高める取り組みとしていくことも不可欠である。

日立は,今後もLumadaをはじめとするデジタル事業において,付加価値の創出に取り組んでいく。