顧客と共に成長するためのイノベーション

デジタルシステム&サービス研究開発

Column:生成AIの動向と日立の研究への取り組み

- 鯨井 俊宏,間瀬 正啓

- 日立製作所 研究開発グループ 先端AIイノベーションセンタ メディア知能処理研究部

生成AIブーム

生成AI(Artificial Intelligence)が空前のブームとなっている。

2022年7月に公開された画像生成AIサービスMidjourney*は,テキストで描きたい対象を説明するだけで,人間同等以上の画像を生成することができ,明らかに人間以上のクオリティだと言えるだろう。実際に,絵画コンクールで優勝した作品がこのサービスで生成されたものだということが明らかにされ,物議を呼んだ。

さらに生成AIブームに輪をかけたのは,2022年11月に公開されたChatGPTである。チャット形式という利用しやすいインタフェースと,驚くほど多様な活用が可能なことから,2か月で1億ユーザーを突破する大ブームとなった。

MicrosoftはChatGPTを開発したOpenAIに大規模な投資を行い,Azure*上でChatGPTや,そのベースとなっている大規模言語モデルであるGPT(Generative Pretrained Transformer)のサービスを行っている。ChatGPTの機能を拡張するツール群も,続々と出現している。Google,Amazon,Metaなどの米国IT大手や複数のスタートアップが,こぞって独自の大規模言語モデルを開発し,競争が激化している。

このように大きな注目を集めている生成AIだが,従来のAIと何が違うのだろうか。従来のAIシステムは,撮影した工業製品の画像から欠陥製品を発見する,などのように特定の目的のために設計され,学習用のデータが集められ,構築・運用されていた。しかし,生成AIに関しては特定の利用目的をもって設計されていない,というのが従来のAIシステムとの大きな違いである。

実際,ChatGPTのベースとなっている大規模言語モデルGPTは,文章の要約,翻訳,添削などさまざまに活用することができるが,これらの機能を実現するために設計されたわけではない。

GPTが学習時に行っているのは,大量に集められた学習用のデータ(文書)の途中までを見て,それに続く単語を精度良く予測できるようにパラメータを調整しているだけである。それにもかかわらず,入力するプロンプトの工夫によって,要約,翻訳,添削などの機能が実現される。これを機能の創発と呼んでいる。

開発者でさえ想定していなかったさまざまな活用方法が,日々無数のユーザーによって模索され産み出されている。次々に新しいことができるようになり,自らも活用方法を発展させられる,これが今の生成AIブームを支えているエネルギーの一つであろう。

企業内で活用アイデアのコンペ実施など,ボトムアップでの活用方法探索を組織だって行う企業も多い。またトップダウンの取り組みとしては,異なる部署間での情報共有の効率化,熟練労働者が減る中での知識伝承,ソフトウェア開発の内製化への移行など経営課題の解決をめざした取り組みも行われている。

2010年代前半から中盤にかけては深層学習をはじめとしたAIを何かに使いたいというAIブームが起こったが,技術起点でのAI活用はPoC(Proof of Concept)での技術検証止まりになることも多かった。

2010年代後半以降では各企業にDX(デジタルトランスフォーメーション)組織が設立され,自社の経営課題に基づいた目的指向型のアプローチが取られるようになり,PoCを通じてビジネス成果までつながる成功事例が増えた。そしてここにきてChatGPTをはじめとした生成AIが大きな着目を浴びるようになり,再び生成AIを何かに使えないか,という技術起点でのPoCが期待されるケースが増えている。生成AIの活用については,上記のようなボトムアップの取り組みと,目的指向型のトップダウンの取り組みの両輪で進めて行くことが重要だと考えている。

生成AIがもたらす機会とリスク

生成AIの開発競争が激化し,さまざまな知的業務への適用が加速している中で,著作権侵害,プライバシー,AI倫理,情報漏洩などのリスクが懸念されている。特に,現在の大規模言語モデルにはハルシネーション(幻覚)と呼ばれる,まことしやかな嘘をつく,という現象が知られている。プロンプトの工夫などによりある程度抑止できるが,この現象は確率的に単語を生成していくGPTのメカニズムに起因するため,完全に避けることはできない。大規模言語モデルの高度な創発能力の裏返しとも言える性質である。生成AIを使いこなすには,権利侵害や情報漏洩に対する入力への注意はさることながら,出力の信頼性の適切な考慮が不可欠である。

生成AIがもたらす機会とリスクについては,2021年にスタンフォード大学が基盤モデル(Foundation Model)の概念を提唱しており,その技術的な側面のみならず,応用の可能性と社会への影響まで含めた詳細なレポートを公表し1),学術界で活発に議論されてきた。そして,ChatGPTをはじめとする生成AIの爆発的な普及を受けて,社会的な議論に発展している。生成AIの能力への過信を防ぐため,人権侵害を防ぐため,あるいは悪用への対策のため,世界各国で法規制やガイドライン整備が進められている。

欧州では2021年4月にAIに対する世界初の包括的な規制法案EU AI Actが提出され2),審議が進められていた。審議終盤の2023年6月の欧州議会による修正案において,基盤モデルを用いた生成AIの開発者に対して,安全性の検査,生成物がAIによるものであることの明示,学習に利用した著作物の開示などを求める条項が盛り込まれ,2023年12月に大筋合意に至っている。米国では2023年10月にAIの安全性に関する大統領令を公表し,基盤モデルを開発する企業に対して,学習を行う際の政府への通知と,安全性とセキュリティの検証結果の政府への共有を義務付けている。日本ではAI戦略会議を中心に生成AIを含めたAI開発・利活用の方針が示され3),事業者向けガイドラインの作成が進められている。

国際協調の動きも進展している。2023年10月にG7広島AIプロセスの首脳声明が採択され4),開発から利用に至るすべてのAI関係者に向けた指針と,AIの開発者向けに精緻化した行動規範が公開された。2023年11月には英国主導でAIセーフティサミットが開催され,米中欧日を含む28か国およびEUによる,AIの安全性に向けた自主的な取り組みとして,ブレッチリー宣言が採択された5)。

これらを実践していくためには,国際的な技術標準が重要な役割を担うことが期待される。ISO/IEC JTC1 SC42ではAIに関する国際標準規格が開発されており6),ISO/IEC 42001 AI Management Systemや,AIの信頼性に関する多数の規格が開発されている。

日立は,2021年2月に社会イノベーションビジネスに向けたAI倫理原則を発表し,LDSL (Lumada Data Science Laboratory) のAI倫理専門チームを中心に社内教育やリスクアセスメントの実践を進めてきた。生成AIの急速な普及に伴い,2023年4月に社内向けの利用ガイドラインを策定してリスクを周知徹底するとともに,適切な安全管理に基づくインフラを整備し,専門家による助言の下で運用する体制を確立している。2023年5月にGenerative AIセンタを設立し,リスクを管理しながら生成AIの活用を進めている。

研究への取り組み

日立でのAIの研究は,1960年代より画像,音声,言語処理と言ったメディア・知識処理において開始され,製品検査装置,海外向けATM(Automated Teller Machine),指静脈認証などの事業に貢献してきた。言語処理に関する研究も最も早くから着手した研究テーマの一つであり,現在も言語処理に関する国際コンペで上位の入賞を続けている。2013年にはディベートAIと呼ばれる,議論テーマを与えると,経済,環境,政治などの観点で賛成/反対の意見を大量のドキュメントから抽出・整理して文章として生成するAIの開発を行った7)。日立は,これらの研究実績をベースに生成AIの研究を進めている。

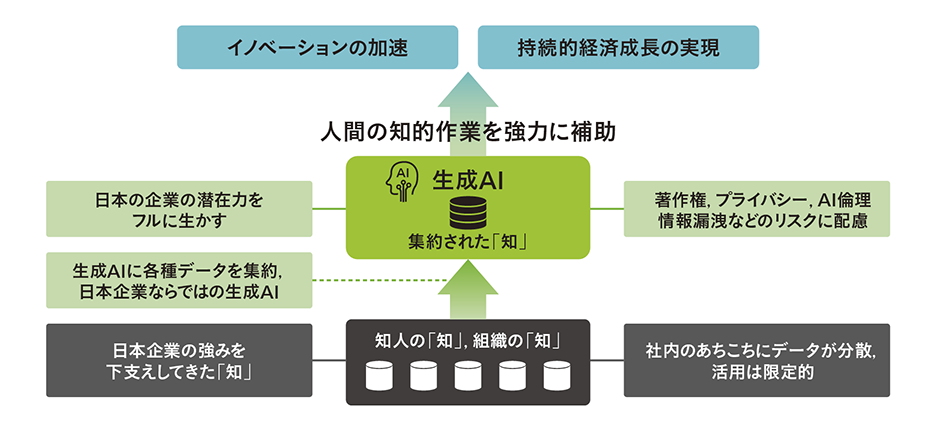

日本企業には,その強みを下支えしてきた,先人の「知」や組織の「知」がある。一方で,こうした「知」は,これまで明文化されていなかったり,あちこちに散らばっていたりするため,まだまだ活用の余地が残されている。日立は,生成AIが,これらの「知」の集約とインタプリタの役割を果たすと考えている。

著作権やプライバシーに配慮しながら,企業が持つ潜在力としての「知」をフルに生かし,人の知的作業を強力に補助することで,人間はよりクリエイティブな業務に集中できるようになる。「知」の抽出,「知」の整理,「知」の活用のあらゆる場面で生成AIは活用できるが,生成AI単独では不足する部分もあり,これまで培った自然言語処理技術との融合が必要になると考えている。

OT(Operational Technology)×IT×プロダクトへの取り組みによって蓄積された「知」と,60年の蓄積で磨かれた信頼性の高いAIの研究力で,日立はイノベーションを加速し,持続的な経済成長を実現していく。

参考文献など

- 1)

- Bommasani et. al. On the Opportunities and Risks of Foundation Models

- 2)

- European Commission, Proposal for a REGULATION OF THE EUROPEAN PARLIAMENT AND OF THE COUNCIL LAYING DOWN HARMONISED RULES ON ARTIFICIAL INTELLIGENCE (ARTIFICIAL INTELLIGENCE ACT) AND AMENDING CERTAIN UNION LEGISLATIVE ACTS

- 3)

- AI戦略会議 第5回 資料より 新事業者向けAIガイドライン スケルトン(案)(PDF形式、280kバイト)

- 4)

- 広島AIプロセスに関するG7首脳声明

- 5)

- The Bletchley Declaration by Countries Attending the AI Safety Summit

- 6)

- ISO/IEC JTC1/SC42 Artificial Intelligence

- 7)

- 人と人工知能がともに賢くなる社会の実現:~ディベート型人工知能のすすめ

1. ドメインナレッジを統合し産業用コンピュータビジョンを実現するセルフサービス型プラットフォーム

映像解析は,検査などの産業用アプリケーションで広く用いられている。しかしながら,その大半はポイントソリューションであり,顧客が機械学習エンジニアに映像データのドメインコンテキスト(環境固有の詳細情報・制約条件)を伝えて機械学習モデルのパフォーマンスに関するフィードバックを提供するような,体系的なプロセスとなっていない。

この課題に対処するため,最小限のシステム統合により,学習モデルのライフサイクル全体に渡り拡張可能なセルフサービス型映像解析プラットフォームを開発した。このプラットフォームは,クラウドベースのモデルトレーニングおよびライフサイクル管理とAWS*ベースのエッジオーケストレーションのためのクローズドループのサイクルを実装する。生成AIを使用して長時間の映像ファイルをシームレスに探索し,対象領域を特定し,画像に自然言語で記述されたドメインコンテキストのラベル画像を付ける。このプラットフォームは,日立Astemo株式会社に導入されており,保守,品質,運用などの複数のアプリケーションに利用可能なほか,コスト削減とソリューション展開の迅速化が実証されている。また,日立デジタルサービス社が日立レール社のWMATA(Washington Metropolitan Area Transit Authority)工場に納められたすべての映像解析アプリケーションのオーケストレーションにも使用されている。

(日立アメリカ社)

2. 行動変容デザインを応用した日立従業員の主体的な業務行動を促進するアプリ開発

業務の中には,業務報告や日報提出など日々実施を期待されているものがある。ワークスタイルの多様化が進む昨今においては,職場マネジメント観点でも着実に実施することが重要だが,一方で一律・全方位的なフォローアップだけでは,受け手である従業員が自分ごととして捉えることが難しく,徹底につながりづらいという課題がある。

そこで,業務報告の毎日実施を目標に,リマインダー施策をコア要素としたポップアップアプリを開発した。TTM(Transtheoretical Model)や認知バイアスといった行動変容の知見を応用してデザインした本アプリは,インタビューやアンケート調査から,頻度やタイミングなどの報告行動の特徴に基づいた従業員ニーズを特定し,それらの要件に基づいて提示コンテンツ・頻度を変化させることで,従業員の主体的な業務行動が促進されることを実証で確認した。

日立製作所従業員約1万2,000人に対して運用を開始しており,今後は他の業務活動への適用拡大を図り実証を継続していく。

3. マイナンバーカードを起点とした個人認証サービス活用

近年,マイナンバー*カードの普及に伴い,官民問わず公的個人認証サービス(JPKI:Japanese Public Key Infrastructure)をさらに活用していく機運が高まってきているが,現状では官民のマイナンバーカード対応サービスが個々のユースケースごとに開発されており,二重開発による非効率な投資や各サービス間のスムーズな連携の困難さなどが課題となっている。

これらの課題に対し,デジタル庁ではJPKIをトラストアンカーとする認証連携などの機能を持つ「個人向け認証アプリケーション」を提供することで,利用者が官民の各種サービスをオンラインで安心・安全かつ利便性高く利用する方法の検討を進めている。これを受け日立では,(1)JPKIを利用した確実な本人確認と通常利用時にスマートフォンを活用したカードレス認証,(2)認証連携によるさまざまな官民サービスへの統一的なアクセス,(3)ID Walletサービスで個人のID情報を安全に管理しつつサービス利用時に活用,(4)オンラインでの本人同意や意思表示に利用されるデジタル署名をリモート署名サービス化,などを実現する技術開発を進めており,これによりトラストが保証された安心・安全なDX(デジタルトランスフォーメーション)環境整備の実現をめざしていく。

4. 顧客の事業を守るPSIRT向けセキュリティ技術

インターネットに接続される自動車や医療機器などのIoT(Internet of Things)製品におけるサイバー攻撃が増加し,IoT製品提供企業はサイバー攻撃の原因となる脆弱性への対応が求められている。そのため,IoT製品提供企業が,製品の脆弱性に係るセキュリティリスクマネジメントを一元的に行うPSIRT(Product Security Incident Response Team)と呼ばれる組織を構築するケースが増えている。

日立は,PSIRT業務支援サービス向けに,脆弱性情報を仕分け,さらに製品に対する脆弱性の影響判断も支援する技術を開発した。情報仕分けについては,大量の脆弱性情報が公開され仕分けに要する工数が増加しているという課題に対し,情報の分野特定・対応優先順位付け・偽陰性チェックを含む技術群を開発し,関連情報の見逃しを防止しつつ工数の削減を可能とした。影響判断については,詳細な製品管理情報(SBOM: Software Bill of Materials)が用意されていない状況では脆弱性情報との照合が難しいという課題に対し,製品モデルから機能・構成要素を洗い出し,それらを階層化して生成した仮想的なSBOM(仮想化SBOM)を用いることで,SBOMが不完全な場合でも脆弱性の影響範囲の推測を可能とした。

これらの技術をPSIRTに導入することで,脆弱性対応を迅速化・効率化し,顧客の事業継続性の向上に貢献していく。

5. 分散型セキュリティオペレーション

近年のサイバー攻撃は業種横断かつ同時多発的に発生しているが,個々の組織のセキュリティ対応能力や情報不足により,これら脅威への対応の遅延やコストの増加が問題になっている。それに対し日立は,組織間で助け合う「分散型セキュリティオペレーション」の実現をめざしている。

少数ながらも各組織に在籍するセキュリティ専門家の知見を相互に共有し,セキュリティ運用自動化機能で連携して攻撃を検知・対処する技術を開発する。具体的には,各組織のインシデント対応記録など(非構造化データのため他組織での再利用が困難)から,検知・対処手法の知見を機械可読情報として自動生成・共有し,自動実行することで,多様なサイバー攻撃に各々の組織が対応できるようにする。本技術により,進化するサイバー攻撃によるリスクの低減,対応コストの削減をめざす。

今後,技術の社会実装,連携組織の拡大を進め,安心・安全な社会インフラの実現に貢献していく。

6. 生成AIを活用した統合システム運用管理JP1における障害対応支援

ITシステムにおける障害対応は,システムの状態や構成,エラーメッセージなどの確認や調査,対処など,専門的な知識や技術が必要な作業である。そこで,ITシステム運用管理の負担の軽減に向け,生成AIを活用した障害対応アシスタントのプロトタイプを開発した。

障害対応アシスタントは,「統合システム運用管理 JP1」(以下,「JP1」と記す。)と連携し,対象のITシステムの運用情報など,ユーザーの質問文に記載されていない情報を補完することで,対象のITシステムや障害の状況に合わせた回答を生成する。また,JP1製品マニュアルへの情報検索と生成AIによる要約を通じ,回答に必要な専門知識を取得する。

本技術により,ITシステム復旧までの時間が短縮され,また,障害発生時の緊急度が高い状況における,システムの状態確認やエラーメッセージに対する対処法をJP1製品マニュアルで確認するといった作業の負担を軽減し,安心・安全なITシステム運用を実現する。

7. データ格納コストの増大を解決する深層学習を応用した圧縮サービス

データ主導社会の実現に向けた膨大なデータの利活用には,データの格納コストの削減が重要である。これに対して日立は,深層学習を応用したデータ圧縮技術とそのサービス化を研究している。

例えば,インフラ保守のデジタル化などを想定する場合,分析に必要な動画データの格納コスト増大が課題になると考えられる。そこで,ユーザーがオブジェクトの種類を指定し,オブジェクトの種類の認識に基づいて画質・データ量を制御することにより,その種類に該当する画像の領域の画質を維持しながら,高圧縮する技術を開発した。そして,本圧縮技術をサービス化しデータストレージと連携させることで,格納が必要なデータ量を削減する。これにより,例えば保守が必要な設備の画像の領域の画質を維持しながら,それ以外の領域を高圧縮し,膨大な動画データの格納コストを削減する。

今後は,公共,金融,交通,製造業などの分野における各種業務のデジタル化に際したデータ格納活用を想定し,実用化に向けた研究を推進していく。

8. ストレージにおけるHDD故障予兆検知の精度向上技術

ハイブリッドクラウドソリューション「EverFlex from Hitachi」は,ストレージで稼働するHDD(Hard Disk Drive)の故障予兆を検知する技術により,可用性の高いITシステムを実現している。ITシステムのさらなる可用性向上を実現するために,機械学習を活用し,故障予兆検知の精度改善と検知早期化が可能な検知条件を自動生成する技術を開発した。

本技術は,HDDが故障する前のエラー出力と正常に稼働するHDDのエラー出力を機械学習技術で分析することで,故障直前の特徴を捉え,故障する可能性があるHDDを未然に検知する条件を自動生成する。本技術により,ストレージ運用を通じて蓄積する情報から,より高精度でかつ早期に予兆検知可能な検知条件を自動生成し,故障予兆検知を継続的に改善する。

9. 系統連携型ITワークロード制御技術

カーボンニュートラル実現に向けて,再生可能エネルギー(以下,「再エネ」と記す)発電の大幅な拡大が見込まれているが,電力系統の制約を要因とした再エネの出力制御や電力設備増強による社会コストの増加が課題となっている。さらに,データセンター(DC:Data Center)の電力需要はAI普及などのため大幅な増加が見込まれている。電力の託送コストに比べて,ITワークロードや処理データの通信コストの方が経済的なことから,再エネが多く発電されている地方エリアにDCを設置し,ITワークロードを地方のDCで処理することによる再エネの地産地消が求められている。

日立は,東京電力パワーグリッド株式会社との協創を通じ,分散配置したDCの電力需要制御による課題解決をめざし研究開発を進めている。DCで実行されるITワークロードの実行場所や時間を制御することで,従来の分散電源(DER:Distributed Energy Resources)では難しかったエリアを越えた電力需要を最適化する技術を開発した。遠隔地のDCを接続し,調整要求にあわせてITワークロードの空間シフト,DC内時間シフト,およびDC内の空調などの設備の制御により複数エリア間で電力需給調整ができることを実証した。

今後,社会実装に向けて,DC事業者との連携や他DERとの連動を深めていく。

10. Low-Codeサービスマッシュアップ基盤

ローコードでアプリケーションシステムの迅速開発を可能にするサービスマッシュアップ基盤技術を開発している。サービスマッシュアップ基盤は,システム開発にモジュラー型開発手法の考えを導入し,既存のサービスアセット部材をつなぎ合わせた,コンポーザブル開発の実現をめざしている。

サービスマッシュアップ基盤が備えるパイプラインエンジンを介してSaaS(Software as a Service)やマイクロサービス,業務タスクなどのサービスアセット部材を再利用してそれらをつなぎ合わせることで,少ないコーディングでプロセスやデータを連係し,サービスチェイニングや業務プロセス自動化を実現する。また,分散システムのデータ一貫性保証技術により,サービス間を横断した高信頼なトランザクションを実現できるのも特徴である。これにより,サービス横断での資源予約や取引実行などの複数サービス部品に跨るデータ一貫性が求められる複雑な用途にも対応できる。

サービスマッシュアップ基盤を用いることで顧客との協創開発を加速でき,要望を持ち帰ることなくその場でシステムイメージを具体化して議論する要件定義や,カスタマーサクセスに向け試行と検証を繰り返して段階的にシステムをアップデートしていく開発運用がより実現しやすくなる。

11. Web3を支える自己主権型ID基盤技術

個人情報やその証明書をユーザー自身がコントロールして選択的に開示できる自己主権型ID(SSI:Self-sovereign Identity)と呼ばれる新しいID管理の概念が,Web3実現要素の一つとして注目されている。

SSIは金融,製造業,ヘルスケアなどのB2B(Business to Business)事業にも適用できる。図に企業間取引の実績証明の例を示す。従来,中小企業は新規取引開始時に取引先に過去の取引実績を証明できないため十分な信用が得られず,契約が滞るという課題があった。SSI基盤を活用することで,既存取引先が発行した取引実績の証明書を開示可能な範囲に限定して新規取引先に提示できる。新規取引先は証明書の真正性を検証できるようになり,取引開始を効率化できる。

このSSIの実現にあたっては,特定事業者に依存せずにデータを検証する必要があり,実質的にブロックチェーン技術が必要である。

日立は企業向けブロックチェーンの主要OSS(Open Source Software)であるHyperledger*を活用したSSI基盤の研究開発を推進し,同OSSのプレミアメンバーとして技術貢献することで実用化を加速する。

12. 運用時のAIの品質を維持するためのAIマネジメント技術

近年,ミッションクリティカルシステムを含む多岐にわたる領域でAIの本番運用が進んでいる。これに伴って,運用中の環境変化が原因でAIの判断精度が低下する「コンセプトドリフト」と呼ばれる問題が顕在化してきた。

この問題を解決してAIの品質を保つため,コンセプトドリフトの発生を早期に検知し,最適なデータを選択してAIに効率的に再学習させるAIマネジメント技術を開発している。特に,産業分野で多く扱われる回帰問題を解くAIに対しては有効な従来技術が存在しなかったため,今回,回帰問題にも適用可能な手法として,「Regression-via-Classification型ストリーミング能動学習アルゴリズム」を新たに開発した。複数のデータセットにおいて,より少ない量の正解データしか与えられなくてもより高い回帰精度を維持できることを確認し,本技術の有効性を示した※)。

本成果の論文は,信号処理のトップカンファレンスである2024 IEEE International Conference on Acoustics, Speech, and Signal Processing(IEEE ICASSP 2024)に採録されている。

- ※)

- Shota Horiguchi, Kota Dohi, Yohei Kawaguchi, “Streaming Active Learning for Regression Problems Using Regression via Classification,” arXiv:2309.01013(2023)

13. 希少事象の検知に活用可能な生成AI技術

近年,地球温暖化による気候変動や都市化に伴って,日本だけでなく世界各地で自然災害による大きな被害が発生している。災害発生時の人命救助・復旧を的確かつ効率よく進めるためには,AIを活用した高度な認識や状況理解に基づき,災害の全容をいち早く把握することが有効である。

災害に代表されるような,発生頻度は高くないものの,ひとたび発生すると影響が甚大な事象に関しては,その事象をAIに学習させるためのデータを収集すること自体が課題である。そこで日立は,生成AIやCG(Computer Graphics)を活用して希少事象を再現し,学習データとして活用することで,レア事象の検知を可能とする映像解析技術の開発を進めている。

今後,本技術を活用した災害時の対策を支援する社会イノベーションを推進し,自治体や設備保守,保険会社などのパートナーとの協創を通じて,レジリエントな社会,人々の安心・安全な暮らしの実現に貢献していく。

14. CMOSアニーリングの適用事例の拡大

サステナブルな社会の実現に向けて,人や環境に配慮した社会システムの運用最適化が求められている。このような需要に応えるため,最適化問題の実用解を高速に探索できるCMOS(Complementary Metal-oxide Semiconductor)アニーリングを開発し,社会システムへの適用を進めている。

最近の事例として,株式会社アイシンと日立で,製造工場周辺の渋滞解消に向けた協創を実施した。従業員が特定の時刻に集中して退勤すると,従業員の車両が多く通る道路で渋滞が発生する。そこで,周辺道路上で車両が分散して通行するように各車両の退勤時刻を最適化することで混雑が抑制できると考えた。これを検証するため,製造工場周辺の各駐車場からの車両の退勤ルートを考慮し,CMOSアニーリングによる退勤時刻の最適化を行った。得られた退勤計画を交通シミュレータにより評価した結果,渋滞が解消され,車両全体が退勤に要する時間が1/3以下に低減される見通しを得た。

今後は得られた知見を生かして,さまざまな施設周辺道路の交通状況改善に取り組み,交通システムのエネルギー効率化やCO2排出量削減に貢献していく。

15. 社会インフラDX

社会インフラ設備が老朽化してきており,今後も老朽設備の増加が見込まれている。また,熟練保守員の高齢化と不足により巡回目視点検による社会インフラ設備の運営保守品質が問題になっている。そこで,デジタル技術を活用した社会インフラ設備の可視化や遠隔監視による保守業務の効率化をサポートする社会インフラ保守プラットフォーム事業を展開している。

これらを展開していく中で,顧客が管理する社会インフラ設備をデジタル空間で管理したり,複数の事業体がそれぞれ個別に管理する社会インフラ設備を統合管理する情報プラットフォームの必要性の高まりから,地上と地下の社会インフラ設備を一元管理するインフラデジタルツインを開発した。各事業体が管理する設備台帳図面の位置を合わせる図面位置整合技術を開発して適用している。

今後は,本インフラデジタルツインによる社会インフラ設備の保守計画や保守業務の効率化への貢献を加速していく。

16. Chemicals Informaticsによる高効率材料探索

公開されている特許・論文のデータをAIで分析することにより材料を探索する「Chemicals Informatics(CI)」※)を開発した。このCIを用いて,温度測定デバイスにおける白金(Pt)薄膜のガラス基板(SiO2)からの剥離を防止する目的で,PtとSiO2の間に接着層として挟む材料を探索した。この結果,PtとSiO2の両方に対して剥離強度の高い材料としてチタン(Ti)を見いだした。

Tiの有効性を確認するため,分子シミュレーションによる剥離エネルギーの計算と,スクラッチ試験による剥離臨界荷重の測定を行った結果,いずれもTiが高い剥離強度を示すことが確認できた。また,高い剥離強度を発現するメカニズムとして,Tiの原子間隔(0.296 nm)とPtの原子間隔(0.278 nm)が近く,約6%の相対差しかないため,PtとTiの界面で原子が規則的に配列することを明らかにした。これらの知見を基に,実際にTiを接着層としてデバイスを作成した結果,Ptが剥離しないことが確認できた。以上により,CIが材料探索に有効であることを実証した。また,探索から実証実験までのプロセスを約2か月間で完了しており,CIを使わなかった場合(推定約3年)と比較して,材料設計の時間を大幅に短縮できることがわかった。今後は,カーボンニュートラル向けのさまざまな材料探索・設計に適用していく予定である。

- ※)

- 株式会社日立ハイテクのソフトウェア,サービスの名称。

17. 企業トラスト評価技術の開発

近年,パンデミックや政治的対立に伴う部素材不足,ESG(Environment,Social ,Governance)を重視した取引先選定など,サプライチェーンを取り巻く環境は複雑化している。このような社会情勢の変化に対応するために,強じんなサプライチェーンを構築することが企業に求められている。

これに対し日立は,サプライヤ情報を一元管理し,サプライヤのトラストを評価することで製造業者のソーシングを支援するソリューションを開発した。本ソリューションでは,サプライチェーン上での企業間のつながりを可視化し,企業間の受発注情報や外部情報を活用して,E(Environment),S(Social),G(Governance),F(Finance),Q(Quality),C(Cost),D(Delivery)の総合的な観点で企業をスコアリングする。これにより,製造業者は適切なサプライヤを選択でき,強靭なサプライチェーンを構築することが可能となる。

今後も,サプライチェーン管理を高度化する技術開発を推進し,さまざまな社会情勢の変化に対応できるようなサプライチェーンの構築に貢献していく。

18. サプライチェーン連携によるカーボンフットプリント算定

2050年のカーボンニュートラルに向けた産業サプライチェーン全体の脱炭素化には,CO2排出量の正確な把握と削減努力が不可欠である。その中で,調達品のCO2排出量(スコープ3カテゴリー1)は調達金額や調達量に業界平均値などの排出原単位を乗じる算定方法を用いるのが一般的であり,企業の削減努力を反映できないという課題があった。JEITA(Japan Electronics and Information Technology Industries Association)のGreen x Digitalコンソーシアムでは,データ連携のための共通データフォーマットや接続方式としてWBCSD(World Business Council for Sustainable Development) PACT(The Partnership for Carbon Transparency) Pathfinder※)をベースとした可視化フレームワークとデータ連携技術仕様を策定し,実効性を確認する実証実験を2022年9月から2023年6月にかけて実施した。日立グループもソリューションプロバイダおよびユーザーとして実証実験に参画し,EcoAssist-Pro/LCAをはじめとする既存の環境系ソリューションと,他社ソリューションと連携するための共通ゲートウェイを新たに開発して,サプライチェーンCO2排出量を正確かつ効率的に把握できること,CO2排出量算定方法と技術仕様の実効可能性を確認した。今後は,より広いユーザー企業への適用を促進し,地球環境の脱炭素化に貢献していく。

19. 省エネかつ低コストな制御システムを実現するオープンソースCPU活用技術

コストパフォーマンスが高いオープン規格のCPU(Central Processing Unit)であるRISC-V*を活用して,制御システムを構築する際に課題となる異種CPU間でのソフトウェア移植を容易化し,新製品開発や半導体EOL(End of Life)対応を迅速化する技術を開発した。

異種CPU間でソフトウェアを移植する際には,データのビット配列の違いやメモリ管理など周辺機能の違いからソフトウェアを大きく変更する必要があった。本研究では複数の実装例からCPUに依存する部分を抽出し,用途に応じてソフトウェア実装方法を体系化し再利用性を高めた。さらに,コスト低減の要請により複数装置を統合したいというニーズに対応するため,ハイパーバイザ(仮想CPU実行環境)を活用することで複数装置の統合を容易化し,既存ソフトウェアの移植に要する変更量を数千行規模で大幅に削減することを可能とした。

今後,鉄道向け車上・地上制御装置,自動車ECU(Electronic Control Unit),産業用制御装置への適用を図る。

本技術は,国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO:New Energy and Industrial Technology Development Organization)の委託業務(JPNP16007)の結果得られたものである。

20. 工場の生産性向上と環境負荷削減に貢献する環境配慮生産ソリューション

近年,カーボンニュートラル達成などの環境への意識の高まりから,製造業では,従来の生産性向上に加えて消費電力などの環境負荷低減のニーズが高まっている。このような生産性向上と環境負荷低減を両立した生産改革の実現には,生産性や環境負荷を悪化させる設備や稼働状態などの要因を特定し,それに対する有効な生産改革の施策立案が求められる。

これに対して,設備稼働実績や消費電力の時系列データの分析結果に基づいて,設備の稼働状態単位で消費電力量をモデル化する技術をコアとし,生産性と環境負荷を精緻に予測するシミュレーション技術を開発した。これにより,生産計画最適化やライン編成変更,設計変更などの各種生産改革の効果を,生産性と環境負荷に関するKPI(Key Performance Indicator)で評価することが可能となる。

今後,本技術を活用して,工場の生産性向上と環境負荷削減を両立した環境配慮生産ソリューションの提供をめざす。

21. プラント向けリアルタイムAI制御技術ZEL

プラント運用分野では,少子高齢化や労働人口の減少に伴い,AI技術による熟練オペレータの代替に対する期待が高まっている。AIによるプラント制御の自動化では,急峻に変化する制御目標値に対応する即応性を備えつつ操作の導出過程を可視化する,高い説明性が求められる。本開発のZEL(Zero-episode Learning)では,従来AI制御で多大な計算時間を要したシミュレータとの収束計算を数学的に等価な統計モデルの行列計算式に置換することで,即応性と説明性を両立した。

本手法を,廃棄物発電の蒸気温度制御に適用して約3か月(休炉を除く連続90日)の長期実証運転を行い,日々のごみ質変動に応じた制御目標値に対応しつつ,蒸気温度をより制御目標の近くに追従させる効果を確認した。また,長期運転の成功を経て,AI技術を搭載したAIプラント制御システム「RL-Prophet」を2023年にリリースした。

![[01]セルフサービス型産業用映像解析プラットフォームの概要](/jp/archive/2020s/2024/01/16/image/fig_01.png)

![[02]行動変容の知見を応用したデザインしたアプリ施策](/jp/archive/2020s/2024/01/16/image/fig_02.png)

![[03]マイナンバーカードを起点とした個人認証サービス活用](/jp/archive/2020s/2024/01/16/image/fig_03.png)

![[04]顧客の事業を守るPSIRT向けセキュリティ技術](/jp/archive/2020s/2024/01/16/image/fig_04.png)

![[05]分散型セキュリティオペレーション](/jp/archive/2020s/2024/01/16/image/fig_05.png)

![[06]障害通知イベントを起点とした対応例](/jp/archive/2020s/2024/01/16/image/fig_06.png)

![[07]インフラ保守において想定されるデータ圧縮サービスの適用例](/jp/archive/2020s/2024/01/16/image/fig_07.png)

![[08]HDD故障予兆検知の精度向上技術](/jp/archive/2020s/2024/01/16/image/fig_08.png)

![[09]ITワークロード制御による複数エリア間での需給調整の実証概要](/jp/archive/2020s/2024/01/16/image/fig_09.png)

![[10]サービスマッシュアップ基盤](/jp/archive/2020s/2024/01/16/image/fig_10.png)

![[11]自己主権型ID基盤を用いたユースケース例「企業間取引の実績証明」](/jp/archive/2020s/2024/01/16/image/fig_11.png)

![[12]AIマネジメント技術](/jp/archive/2020s/2024/01/16/image/fig_12.png)

![[13]生成AIによる災害発生画像の生成](/jp/archive/2020s/2024/01/16/image/fig_13.png)

![[14]CMOSアニーリングによる退勤計画最適化](/jp/archive/2020s/2024/01/16/image/fig_14.png)

![[15]インフラデジタルツインの概略図](/jp/archive/2020s/2024/01/16/image/fig_15.png)

![[16]CIで探索した添加剤の効果を示すシミュレーションと実験の結果](/jp/archive/2020s/2024/01/16/image/fig_16.png)

![[17]サプライチェーンを取り巻く課題とソリューション概要](/jp/archive/2020s/2024/01/16/image/fig_17.png)

![[18]サプライチェーン連携によるカーボンフットプリント算定](/jp/archive/2020s/2024/01/16/image/fig_18.png)

![[19]ソフトウェア移植容易化技術](/jp/archive/2020s/2024/01/16/image/fig_19.png)

![[20]消費電力モデルを用いた生産性・環境KPI最適化](/jp/archive/2020s/2024/01/16/image/fig_20.png)

![[21]強化学習とZELの比較](/jp/archive/2020s/2024/01/16/image/fig_21.png)